AI-systemen kunnen je website alleen gebruiken als ze er technisch bij mogen.

Met robots.txt bepaal je of AI-bots je content mogen lezen of niet.

In dit artikel leer je:

- wat robots.txt is en waarom dit belangrijk is voor AI-vindbaarheid

- hoe je zelf controleert of AI-bots worden geblokkeerd

- hoe je dit eenvoudig goed instelt met Rank Math Pro

Twijfel je of dit bij jouw website goed staat?

👉 Doe de AI-vindbaarheid scan en krijg rust en duidelijkheid over wat wel en niet in orde is.

Zo zorg je dat AI je website kan lezen (en waarom dit essentieel is)

Steeds meer mensen krijgen antwoorden via AI-systemen zoals ChatGPT, Google AI Overviews en andere “answer engines”.

Maar wat veel website-eigenaren niet weten: AI kan je site alleen gebruiken als die technisch toegankelijk is.

Een van de belangrijkste — en vaak vergeten — onderdelen daarbij is robots.txt.

In dit artikel leer je:

- wat robots.txt is

- waarom het cruciaal is voor AI-zichtbaarheid

- hoe je controleert of het goed staat

- en hoe je dit praktisch oplost met Rank Math Pro

Wat is robots.txt?

Een robots.txt-bestand is een klein tekstbestand dat op je website staat en instructies geeft aan bots.

Het vertelt bots:

- welke delen van je site ze wel mogen bezoeken

- en welke delen ze niet mogen bezoeken

Oorspronkelijk was dit bedoeld voor zoekmachines zoals Google.

Tegenwoordig gebruiken ook AI-bots dit bestand om te bepalen:

- of ze je website mogen lezen

- of ze je content mogen gebruiken in antwoorden

Belangrijk om te begrijpen:

Als een bot wordt geblokkeerd in robots.txt, dan leest die bot je website niet. Punt.

Waarom is robots.txt belangrijk voor AI?

AI-systemen werken anders dan gewone bezoekers.

- Ze zien geen design

- Ze lezen geen intentie

- Ze volgen alleen technische regels

Als robots.txt zegt: “je mag hier niet komen”, dan:

- wordt je content niet geciteerd

- wordt je expertise niet meegenomen

- kan een concurrent wél genoemd worden, ook als die inhoudelijk zwakker is

Je website kan dan:

- prima werken voor mensen

- goed scoren in Google

- maar onzichtbaar zijn in AI-antwoorden

En dat gebeurt vaker dan je denkt.

Wat gaat hier in de praktijk vaak mis?

In de meeste gevallen is er geen “fout”, maar een verouderde of onbewuste instelling.

Veelvoorkomende situaties:

- robots.txt is ooit “veilig” ingesteld en nooit aangepast

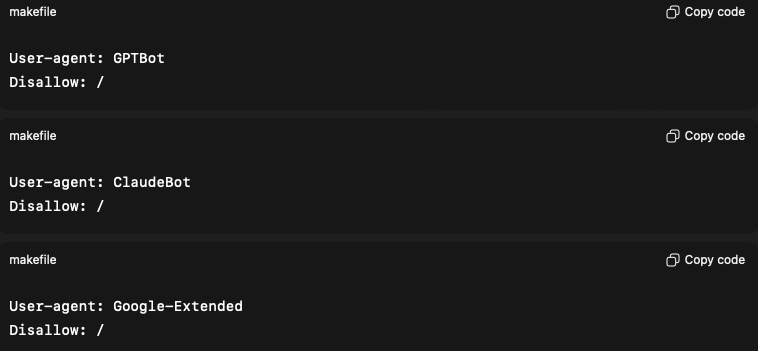

- er staat een algemene blokkade (

Disallow: /) - AI-bots zoals GPTBot of ClaudeBot zijn expliciet geweerd

- Google-Extended (gebruikt voor AI-systemen) is geblokkeerd

Dit gebeurt meestal:

- niet bewust

- niet met slechte intentie

- maar door oude SEO-adviezen of standaardinstellingen

Hoe controleer je of jouw robots.txt goed staat?

Stap 1 — Open je robots.txt

Ga in je browser naar:

(Verander jouwdomein.nl naar je eigen website.)

Wat zie je?

- Een tekstbestand → goed

- Een foutmelding → dan bestaat er geen robots.txt (dat is meestal geen probleem)

Stap 2 — Zoek naar blokkades

Let op regels zoals:

Staat dit erin?

👉 Dan mogen AI-bots je website niet lezen.

Stap 3 — Check algemene regels

Deze regel is extra belangrijk:

Dit betekent:

Geen enkele bot mag iets lezen

Dat is bijna altijd onbedoeld.

Deze regel is wél normaal:

Dat beschermt technische delen en is prima.

Wanneer staat dit op groen?

Je robots.txt is in orde als:

- AI-bots niet expliciet worden geblokkeerd

- Er géén algemene

Disallow: /actief is - Alleen technische mappen zijn uitgesloten

- Bots je content mogen lezen

Kort gezegd:

AI mag je website technisch benaderen.

Robots.txt verbeteren met Rank Math Pro (stap voor stap)

Gebruik je WordPress en Rank Math Pro? Dan is dit eenvoudig op te lossen.

Stap 1 — Open de robots.txt-editor

- Log in op WordPress

- Ga naar Rank Math → General Settings

- Klik op Edit robots.txt

Hier zie je de actieve robots.txt van je website.

Stap 2 — Verwijder ongewenste blokkades

Controleer of je regels ziet die AI-bots blokkeren, zoals:

Verwijder deze regels volledig

(of vervang ze door Allow: /).

Stap 3 — Houd het bestand eenvoudig

Een veilige basisconfiguratie is bijvoorbeeld:

Dit:

- beschermt technische delen

- laat alle inhoud toegankelijk

- voorkomt onbedoelde blokkades

Meer is meestal niet nodig.

Stap 4 — Opslaan en controleren

- Klik op Save Changes

- Open opnieuw

/robots.txtin je browser - Controleer of de blokkades weg zijn

Als jij het kunt lezen, kunnen bots dat ook.

Veelgemaakte fouten (en waarom ze niet werken)

- ❌ “We blokkeren alles voor veiligheid”

→ Dan blokkeer je ook AI - ❌ “Google ziet ons toch wel”

→ AI is geen Google Search - ❌ “Dit regelen we later”

→ AI kiest nú al andere bronnen

Wat hoef je níét te doen

Voor dit onderdeel hoef je:

- geen nieuwe content te schrijven

- geen pagina’s te verwijderen

- geen redesign te doen

- geen extra tools te installeren

Het gaat om één klein tekstbestand met grote impact.

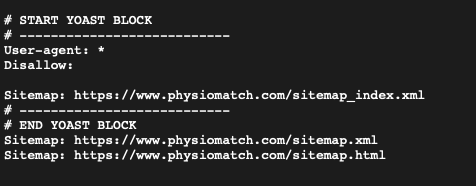

Wat we nu zien bij PhysioMatch (duiding)

De huidige robots.txt (zoals op het screenshot) is:

Wat betekent dit?

User-agent: *→ geldt voor alle botsDisallow:→ leeg, dus: niets wordt geblokkeerd- Sitemaps zijn correct opgegeven

👉 Dit is technisch gezien al “groen”

AI-bots mogen de site lezen.

Extra: wat je niet zou willen:

n deze situatie mogen AI-bots de website niet lezen. De site kan dan wel zichtbaar zijn in Google, maar wordt niet gebruikt in AI-antwoorden.

Samenvatting

- Robots.txt bepaalt of AI je website kan lezen

- Verkeerde instellingen maken je onzichtbaar voor AI

- Je kunt dit zelf controleren in de browser

- Met Rank Math Pro is het eenvoudig aan te passen

👉 Als AI-bots je content mogen lezen, staat dit punt op groen.